“El modelo GPT-4 diagnosticó correctamente el 57 % de los casos clínicos frente al 36 % de los médicos humanos, pero eso no significa que piense como un clínico”, señala el Dr. Fernando Bonilla Sinibaldi, autor del análisis publicado en IntraMed. Su reflexión parte de un hecho innegable: la inteligencia artificial ha irrumpido en la medicina con una fuerza vertiginosa, pero todavía está lejos de comprender lo que significa curar.

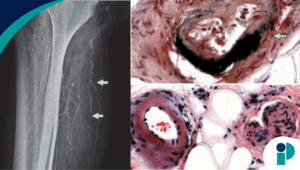

Los avances técnicos son impresionantes. Modelos de lenguaje como GPT-5, Gemini 2.5 Pro o Claude Opus 4.1 alcanzan puntuaciones entre 85 % y 90 % en los exámenes médicos estandarizados (USMLE o MedQA). En radiología, las redes neuronales ya igualan —y a veces superan— la capacidad diagnóstica de los especialistas en cáncer de mama, melanoma o retinopatía diabética. Sin embargo, en la práctica clínica, estos sistemas tropiezan cuando las variables dejan de ser controladas.

En contextos reales, sin opciones múltiples ni indicaciones cerradas, los algoritmos pierden entre 30 y 40 puntos de precisión. “Lo que hacen no es razonar clínicamente, sino predecir estadísticamente”, explica Bonilla. El modelo puede detectar una opacidad en una radiografía, pero no discernir si es una neumonía, un derrame o un simple artefacto técnico. La intuición médica, producto de años de experiencia y sensibilidad ante el paciente, sigue siendo irremplazable.

Un estudio publicado en Radiology’s Last Exam 2025 ilustró bien esa brecha: radiólogos humanos alcanzaron un 83 % de aciertos, mientras que el mejor modelo apenas llegó al 30 %, fallando por “falta de foco clínico” y “confusión anatómica”. Los investigadores concluyeron que la IA aún no entiende la fisiología ni el contexto: ve datos, pero no historias.

El debate no es solo técnico, sino ético. ¿Quién asume la responsabilidad si una IA comete un error de diagnóstico? ¿Cómo se protege la privacidad de los pacientes cuando los datos entrenan modelos globales? Las sociedades médicas coinciden en que el futuro de la práctica no será de “médicos o algoritmos”, sino de médicos con algoritmos: una colaboración en la que la inteligencia humana defina el rumbo y la inteligencia artificial amplifique sus capacidades.

“La medicina real no ofrece cuatro opciones, sino miles de variables y emociones humanas”, escribe Bonilla. “El médico no elige una respuesta correcta: busca una verdad que todavía no tiene nombre.” Por eso, el verdadero desafío no es que la IA reemplace al médico, sino que el médico sepa integrarla sin perder su esencia.

A largo plazo, los expertos prevén que los sistemas inteligentes se conviertan en asistentes clínicos permanentes: procesarán datos, cruzarán historiales, predecirán riesgos y sugerirán terapias personalizadas. Pero la última palabra —el juicio clínico, la empatía, la mirada al paciente— seguirá siendo humana.

En palabras del autor, “ningún modelo puede responder aún a la pregunta que define la medicina: Doctor, ¿qué haría si fuera su madre?”.

Fuente original aquí