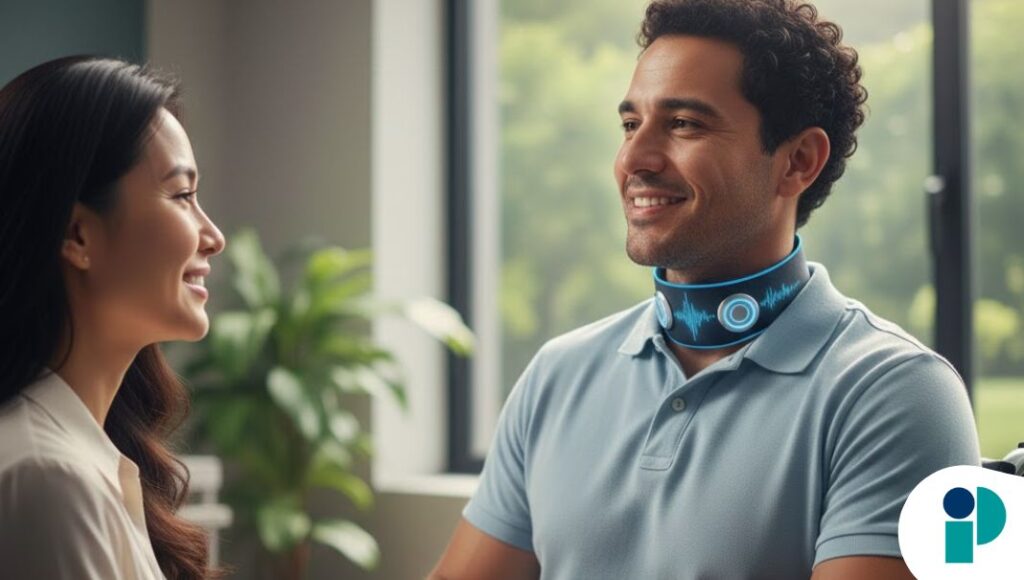

Un innovador dispositivo wearable impulsado por inteligencia artificial (IA) podría transformar la forma en que los sobrevivientes de accidentes cerebrovasculares (ACV) se comunican. Se trata de una gargantilla inteligente capaz de interpretar señales silenciosas de la garganta y del pulso carotídeo para convertirlas en habla fluida, coherente y emocionalmente ajustada, incluso cuando el paciente no puede vocalizar sonidos.

El avance fue evaluado en un estudio reciente publicado en Nature Communications, donde se presenta un sistema denominado “intelligent throat” (IT), diseñado específicamente para personas con disartria, un trastorno motor del habla frecuente en enfermedades neurológicas.

La disartria: una barrera silenciosa para la comunicación

La disartria afecta a pacientes con enfermedades neurológicas como el ACV, la esclerosis lateral amiotrófica (ELA) o el Parkinson, y se produce por la alteración del control neuromuscular del tracto vocal. Las personas que la padecen suelen enfrentar grandes dificultades para expresarse, lo que impacta negativamente en su calidad de vida, su rehabilitación y su bienestar psicológico.

Si bien existen tecnologías de comunicación aumentativa y alternativa, como sistemas de seguimiento ocular, deletreo letra por letra o neuroprótesis, muchas de ellas son lentas, invasivas o demandan un alto esfuerzo cognitivo, lo que limita su uso cotidiano.

El sistema IT propone una alternativa no invasiva, portátil y de bajo consumo energético, pensada para pacientes que aún conservan cierto control de los músculos de la garganta. La gargantilla integra sensores textiles ultrasensibles que capturan:

- Vibraciones de los músculos laríngeos (habla silenciosa)

- Señales del pulso carotídeo, utilizadas para inferir el estado emocional

Estos datos se procesan mediante modelos de aprendizaje automático y grandes modelos de lenguaje (LLM), capaces de generar texto directo o, si el usuario lo desea, expandir expresiones breves en frases completas, manteniendo el significado original y el tono emocional.

Inteligencia artificial que entiende contexto y emoción

Uno de los elementos más innovadores del sistema es su capacidad para integrar emoción y contexto. A partir del análisis del pulso, la IA identifica estados emocionales básicos neutral, alivio o frustración y los incorpora en la construcción de las frases.

Además, el modelo puede añadir información contextual objetiva, como la hora del día o el clima, para producir mensajes más naturales y socialmente funcionales. El usuario decide cuándo activar esta función de expansión inteligente, lo que reduce el esfuerzo físico y mental al comunicarse.

El dispositivo incluye una placa electrónica con conectividad Bluetooth de bajo consumo, un microcontrolador y un convertidor analógico-digital. Todo el sistema consume apenas 76.5 mW, lo que permite uso continuo durante toda la jornada gracias a una batería de 1,800 mWh.

El diseño fue optimizado para evitar interferencias externas, manteniendo un rendimiento estable incluso en ambientes con ruido de hasta 100 dB.

Resultados prometedores en pruebas clínicas

El estudio incluyó a 10 participantes sanos y 5 pacientes con ACV y disartria. Tras el entrenamiento y ajuste del sistema, los investigadores reportaron:

- 96.3 % de precisión promedio por palabra

- 4.2 % de tasa de error por palabra

- 2.9 % de tasa de error por oración

- 83.2 % de precisión en reconocimiento emocional

Además, el uso del modo de expansión de oraciones incrementó la satisfacción del paciente en un 55 %, demostrando que incluso señales mínimas pueden convertirse en mensajes completos y socialmente útiles.

Aunque el estudio se realizó en una cohorte pequeña y con un vocabulario limitado, los resultados sugieren que esta tecnología podría reducir el aislamiento social, facilitar la rehabilitación y devolver autonomía comunicativa a personas con trastornos neurológicos del habla.

Los investigadores señalan que los próximos pasos incluyen ampliar el vocabulario, evaluar el sistema en poblaciones más grandes y explorar su aplicación en otras enfermedades neurológicas.

Este avance marca un hito en la intersección entre neurociencia, inteligencia artificial y tecnología wearable, acercando la comunicación natural a quienes han perdido la voz, pero no el deseo de expresarse.

Fuente original aquí