La inteligencia artificial generativa ha puesto en juego a la ciencia, ya que plantea un reto crítico para la integridad científica. Esta tecnología facilita la creación de textos, imágenes y datos falsos, complicando la detección de fraudes en la investigación.

Expertos en integridad, como Jana Christopher y Elisabeth Bik, expresaron a la Revista Nature su preocupación por la proliferación de contenido generado por IA, especialmente imágenes científicas engañosas. A medida que las «fábricas de papel» explotan esta tecnología, los científicos y editores trabajan en herramientas para contrarrestar estos problemas y preservar la credibilidad de la literatura científica.

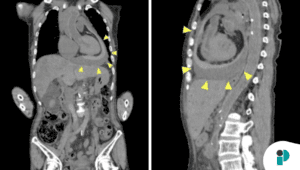

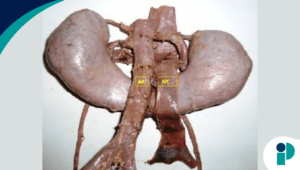

Uno de los problemas principales es la dificultad para identificar imágenes científicas creadas por IA, las cuales son cada vez más, precisas, convincentes y difíciles de distinguir de las reales. Ejemplos recientes han demostrado cómo las herramientas de IA pueden producir figuras engañosas en artículos científicos.

Esto representa una evolución preocupante, ya que la IA permite manipular datos de manera que pasa desapercibida para la mayoría de los editores y revisores. Además, las “fábricas de papel” están utilizando IA para producir artículos en masa, generando una carrera armamentista entre expertos en integridad científica y los desarrolladores de tecnología para detectar estas falsificaciones.

Christopher menciona que esta situación podría derivar en un punto de inflexión para la ética de la publicación académica. Los avances tecnológicos también están impulsando mejoras en los protocolos editoriales y herramientas de verificación, pero la velocidad de desarrollo de la IA genera preocupación. Las publicaciones científicas enfrentan ahora el desafío de implementar controles rigurosos y desarrollar sistemas de inteligencia artificial que ayuden a detectar contenido falso para proteger la integridad de la ciencia.

Detectar la IA detrás de imágenes falsas

Aunque el uso de IA para textos académicos está más aceptado bajo ciertas normas, generar datos o imágenes con IA plantea preocupaciones éticas profundas.

Detectar estos fraudes resulta complejo, ya que las imágenes y datos generados con IA carecen de algunos de los «fallos» típicos de las manipulaciones previas hechas con herramientas como Photoshop. Los detectores de integridad, sin embargo, están desarrollando herramientas específicas para combatir esta nueva modalidad de fraude. Además, las editoriales están implementando políticas para exigir la transparencia en el uso de IA, permitiendo solo algunas aplicaciones de estas tecnologías en los estudios. Esta vigilancia es crucial, ya que se teme que la IA, usada con malas intenciones, permita la creación masiva de contenido falso en cuestión de minutos, afectando la confiabilidad y credibilidad de los hallazgos científicos.

Nuevas herramientas para combatir imágenes falsas en la ciencia

Ante la amenaza de imágenes científicas falsas creadas por inteligencia artificial (IA), herramientas como Imagetwin y Proofig están implementando sofisticados algoritmos para identificar este tipo de contenido. Estas empresas han desarrollado bases de datos propias con imágenes generativas de IA para entrenar sus sistemas y, de acuerdo con sus reportes, Proofig asegura detectar con un 98 % de precisión las imágenes falsas de microscopía. Sin embargo, debido a la complejidad de estas detecciones, los resultados necesitan siempre la revisión de expertos.

Además, Jana Christopher y otros expertos destacan la importancia de utilizar la detección de IA como complemento a la revisión humana, ya que aunque los algoritmos de estas herramientas son prometedores, los resultados necesitan verificación para evitar errores y falsos positivos.